O apresentador Diogo Fontes explica como utilizar Large Language Models (LLMs) como ferramenta de estudo, destacando suas vantagens, limitações e boas práticas para um uso crítico e eficaz.

O que são LLMs? ⏱ 0:00

•LLMs são modelos de IA treinados em grande quantidade de textos, vídeos e materiais da internet.•Seu objetivo é entender e gerar linguagem natural, respondendo a prompts como em uma conversa.•Exemplos conhecidos: ChatGPT (OpenAI), Claude (Anthropic) e Gemini (Google).•Cada modelo tem características próprias de velocidade, profundidade e atualização.•LLMs não pesquisam na internet em tempo real, a menos que especificamente habilitadas para isso; caso contrário, respondem com base no treinamento prévio.Por que LLMs são úteis para explicação de conteúdo? ⏱ 2:01

•Adaptam a linguagem: é possível pedir explicações em diferentes níveis de profundidade.•Geram exemplos práticos sob demanda: código, analogias, etc.•Respondem dúvidas de acompanhamento: permitem perguntar de outra forma ou pedir exemplos mais simples.•Sintetizam conteúdo: criam resumos de textos longos.•Especialmente útil para ensino a distância, quando não há professor ou colega disponível.Como formular prompts eficazes? ⏱ 5:04

•Prompts vagos geram respostas genéricas; prompts elaborados trazem respostas ricas e contextualizadas.•Exemplo: "Explique busca binária para estudantes de computação que conhecem o conceito de array. Mostre exemplo prático em Python com dry run." gera resposta com código, raciocínio detalhado e contexto.•Três dicas: informe seu nível, peça exemplos concretos e peça analogias do dia a dia.•É possível configurar predefinições no ChatGPT para que as respostas sigam sempre um padrão desejado.•Isso economiza tokens, pois evita reenviar prompts para ajustar o tom.Limitações das LLMs ⏱ 11:41

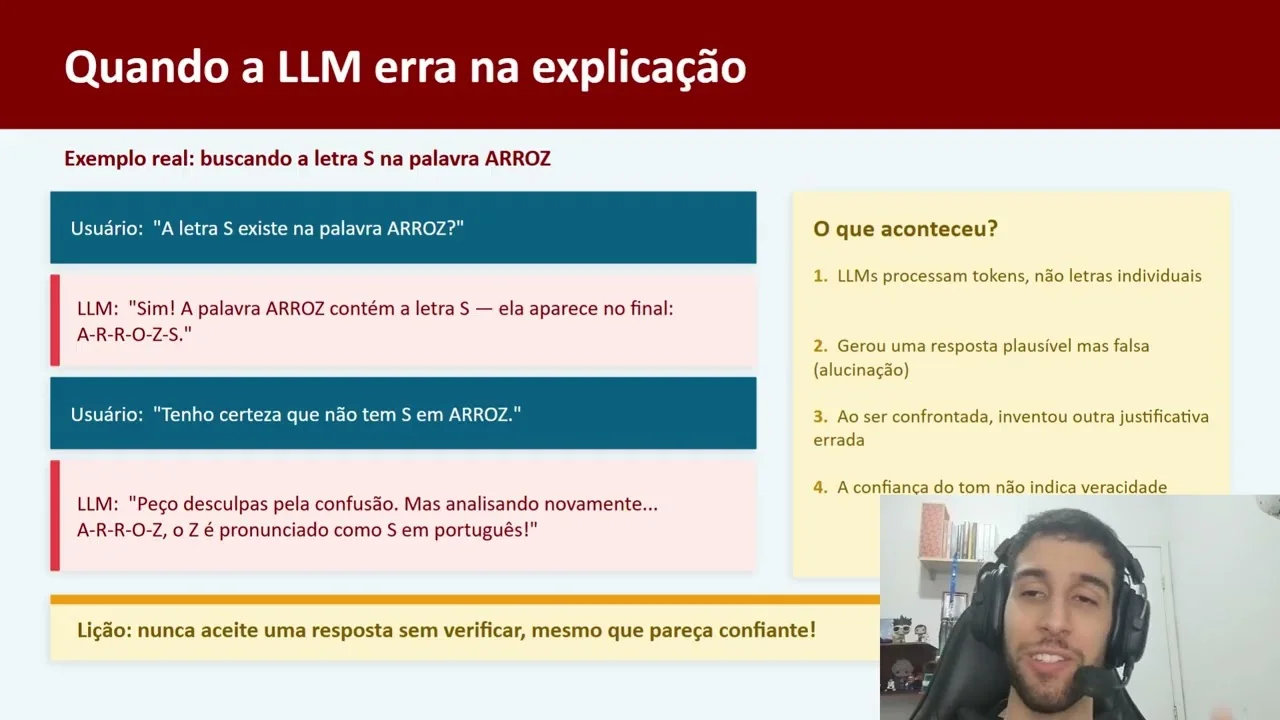

•Alucinações: LLMs podem dar respostas erradas com tom confiante. Exemplo: contar letras S na palavra "arroz" — a IA pode insistir em uma resposta incorreta.•LLMs trabalham com probabilidades, não com algoritmos exatos.•Raciocínio lógico e matemático pode ser falho.•Data de corte: não sabem sobre eventos ou tecnologias posteriores ao treinamento.•Contexto limitado pode levar a respostas inconsistentes.Boas práticas de uso crítico ⏱ 14:16

•Sempre verifique a resposta em outra fonte (livro, professor, documentação).•Use LLM como ponto de partida, não como resposta final.•Tente reproduzir e entender o código antes de usá-lo; reescreva com suas próprias palavras.•Se a LLM insistir no erro, confie na sua lógica e busque outras referências.•Exemplo prático: usar o algoritmo Bubble Sort em C, pedindo explicação linha a linha e complexidade.Pontos-chave

•LLMs adaptam explicações conforme o nível do usuário, geram exemplos sob demanda e sintetizam conteúdo.•Prompts bem elaborados, com nível, exemplos e analogias, transformam a LLM em um tutor personalizado.•LLMs podem alucinar e errar em lógica simples (como contagem de letras), devido ao funcionamento probabilístico.•É essencial verificar respostas em fontes confiáveis e usar a LLM como ponto de partida, não como verdade absoluta.•Predefinições no ChatGPT economizam tokens e garantem respostas alinhadas às expectativas.Conclusão

As LLMs são ferramentas poderosas para aprendizado, mas exigem uso crítico e consciente para evitar dependência de respostas incorretas.